Von verlorenen Schafen und klugen Modellen: Wie KI kulturelle Texte neu erschließt

Im Zentrum des Workshops zu „Computational Linguistics for Cultural Heritage, Social Sciences, Humanities and Literature“ stand die Frage, wie moderne Sprachverarbeitung – insbesondere große Sprachmodelle (Large Language Models (LLMs)) – für die Analyse kultureller, historischer und literarischer Daten eingesetzt werden kann. Die Beiträge spiegelten eine beeindruckende thematische und sprachliche Vielfalt wider, von historischen Textkorpora über literarische Analysen bis hin zu gesellschaftlich relevanten Fragestellungen wie Desinformation oder Sprachdiversität.

Vielfältiges Programm zwischen Theorie und Anwendung

Das Programm des Präsenztages am 29. März umfasste mehrere Sessions zu Themen wie diachrone Sprachdaten, Identität, Informationsextraktion sowie literarische Sprache. Ergänzt wurde dies durch einen eingeladenen Vortrag von Dr. Barbara McGillivray, Dozentin für Digital und Computational Humanities am King's College London, der methodische Perspektiven auf LLMs in den Geisteswissenschaften beleuchtete.

Besonders hervorzuheben ist die Bandbreite der methodischen Ansätze: Neben klassischen Natural-Language-Processing-Techniken (NLP) kamen verstärkt generative Modelle und hybride Verfahren zum Einsatz, etwa zur Annotation historischer Texte, zur Analyse von Propaganda oder zur Untersuchung literarischer Stilistik.

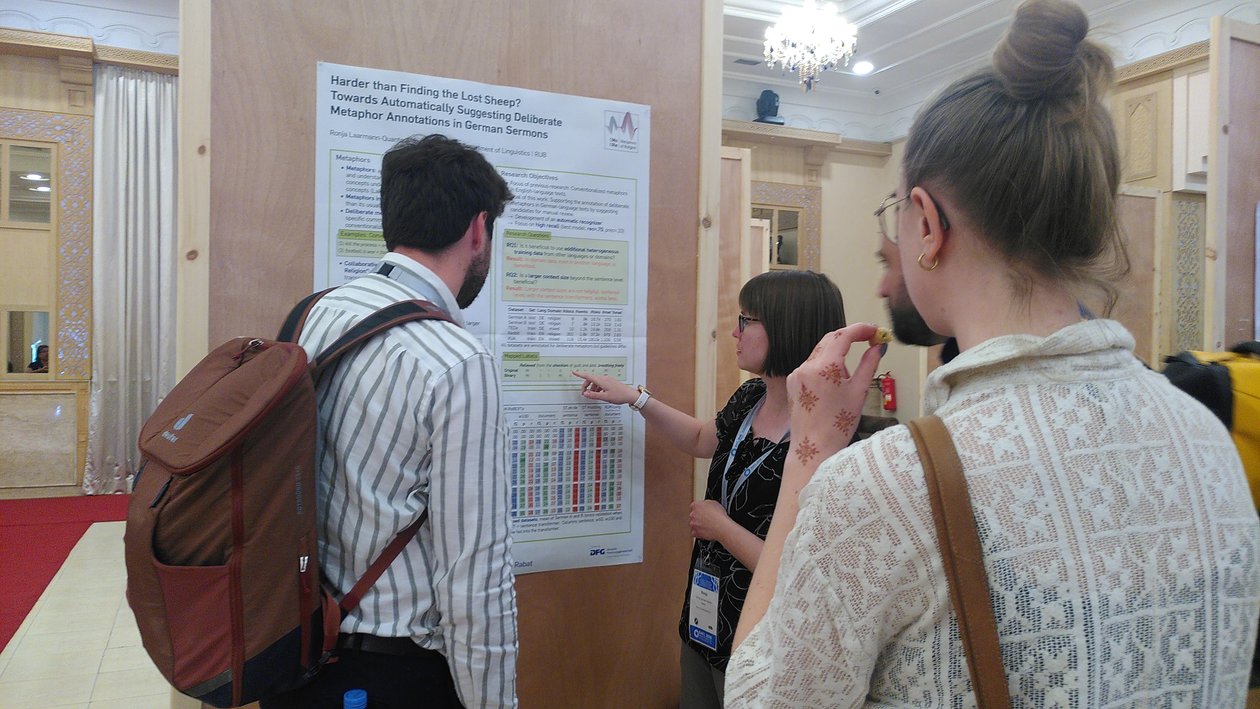

Poster Session als Impulsgeber

Einen zentralen Programmpunkt bildete die Postersession, die Raum für Austausch über laufende Projekte und neue Ideen bot. Hier präsentierten auch Stefanie Dipper und Ronja Laarmann-Quante zum Thema „Harder than Finding the Lost Sheep? Towards Automatically Suggesting Deliberate Metaphor Annotations in German Sermons“.

Die Arbeit adressiert die automatische Identifikation und Annotation bewusster Metaphern in deutschsprachigen Predigten – ein anspruchsvolles Problem an der Schnittstelle von Linguistik, Hermeneutik und maschinellem Lernen. Der Beitrag verdeutlicht exemplarisch, wie computationalle Methoden genutzt werden können, um komplexe interpretative Aufgaben der Geisteswissenschaften zu unterstützen.

Neben diesem Beitrag bot die Postersession weiterhin eine große thematische Breite, etwa in den Bereichen Autorschaftsanalyse, Stilometrie, Sprachvariation, historische Korpora und die Modellierung wissenschaftlicher Konzepte.

Insgesamt verdeutlichte der SIGHUM (LaTeCH-CLfL) 2026 Workshop, wie dynamisch sich das Feld der Computational Humanities entwickelt. Insbesondere die Integration von Large Language Models eröffnet neue Perspektiven für die Analyse kultureller und historischer Datenbestände. Gleichzeitig wurde deutlich, dass die Verbindung von technologischer Innovation und geisteswissenschaftlicher Expertise weiterhin zentral für den Fortschritt des Feldes ist.